O Google lançou o Gemini Embedding 2, um novo modelo de IA projetado para unificar a forma como as máquinas entendem e recuperam informações de diferentes tipos de mídia. Esta não é apenas uma atualização incremental; é uma mudança fundamental na forma como a IA processa dados, potencialmente reduzindo custos e aumentando a velocidade para empresas que dependem de insights alimentados por IA.

O problema com modelos de incorporação anteriores

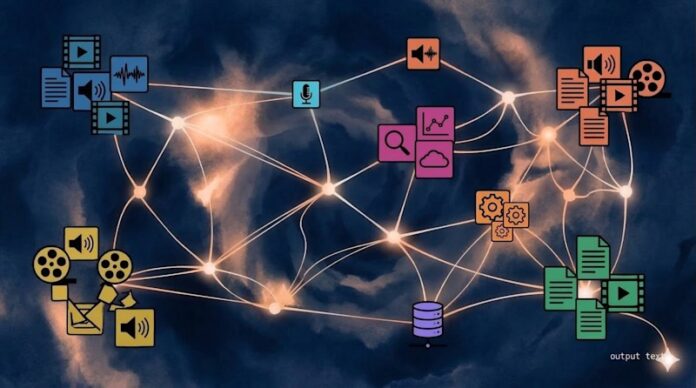

Os modelos de incorporação tradicionais, os mecanismos por trás da pesquisa, das recomendações e da IA empresarial, historicamente se concentraram no texto. Para analisar imagens, vídeos ou áudio, esses modelos primeiro os traduziam em texto, adicionando etapas que introduziam erros e diminuíam o desempenho. Gemini Embedding 2 elimina esse gargalo integrando nativamente texto, imagens, vídeo, áudio e documentos em um único espaço matemático.

Como funciona o Gemini Embedding 2: a analogia da “Biblioteca Universal”

Pense em uma biblioteca antiquada organizada por categorias versus uma biblioteca futurística onde os livros se organizam com base em sua essência. Isto é o que um modelo de incorporação faz: converte dados complexos em coordenadas numéricas em um mapa de alta dimensão. Itens semelhantes agrupam-se, independentemente do formato. Uma foto de um golden retriever e a frase “o melhor amigo do homem” ficariam lado a lado, enquanto um poema do pôr do sol flutuaria em direção a uma fotografia da Costa do Pacífico.

Gemini Embedding 2 mapeia todas as mídias em um espaço unificado de 3.072 dimensões, permitindo que os desenvolvedores pesquisem em formatos sem sistemas separados para imagem, texto ou vídeo. Isso é conseguido por meio do “Matryoshka Representation Learning” do Google, que prioriza informações importantes para eficiência.

Por que isso é importante: eficiência e precisão

A mudança para uma arquitetura nativamente multimodal oferece benefícios tangíveis:

- Latência reduzida : alguns testadores iniciais relatam tempos de processamento até 70% mais rápidos.

- Custos mais baixos : Ao eliminar etapas intermediárias de “tradução”, as empresas podem economizar em recursos computacionais.

- Entendimento mais profundo : O modelo entende áudio como som e vídeo como movimento diretamente, capturando nuances perdidas na análise somente de texto.

Empresas como a Sparkonomy já obtiveram ganhos de eficiência significativos, enquanto a Everlaw está usando o modelo para navegar em tarefas complexas de descoberta jurídica.

Especificações técnicas: o que os desenvolvedores precisam saber

O modelo lida com arquivos com até 8.192 tokens de texto, seis imagens, 128 segundos de vídeo, 80 segundos de áudio e seis páginas PDF por solicitação. Estes são limites de entrada, não limites de armazenamento – o sistema pode lidar com milhões de documentos.

O Google oferece preços diferenciados por meio da API Gemini e Vertex AI:

- Nível gratuito : acesso limitado para experimentação.

- Nível pago : US$ 0,25 por milhão de tokens para texto, imagens e vídeo; US$ 0,50 por milhão de tokens para áudio.

O modelo também está integrado a estruturas de IA populares como LangChain e LlamaIndex, simplificando a adoção. O código é licenciado sob Apache 2.0, permitindo uso comercial sem obrigações de royalties.

As empresas devem migrar?

Para organizações que dependem de pipelines de IA fragmentados, a migração para o Gemini Embedding 2 é provavelmente uma necessidade estratégica. O modelo agiliza fluxos de trabalho, reduz erros e reduz custos. A transição é facilitada pela continuidade da API e pela integração com ferramentas existentes.

No entanto, as empresas devem gerenciar os limites de entrada agrupando arquivos grandes (dividindo-os em segmentos) antes do processamento. O verdadeiro investimento reside na reindexação dos dados existentes para aproveitar totalmente as novas capacidades.

Resumindo: Gemini Embedding 2 não é apenas mais uma atualização de IA; é um passo em direção a uma forma mais unificada, eficiente e precisa de processar informações nas empresas modernas.