Co roku gwałtowne powodzie pochłaniają życie ponad 5000 osób, co czyni je jednym z najbardziej śmiercionośnych zjawisk pogodowych na świecie. Ich nieprzewidywalność wynika z ich szybkiego początku i lokalnego charakteru, który trudno uchwycić za pomocą tradycyjnych systemów monitorowania pogody. Teraz Google jest pionierem nowego rozwiązania: Wykorzystywanie sztucznej inteligencji i milionów doniesień prasowych do przewidywania gwałtownych powodzi w czasie rzeczywistym.

Problem z tradycyjnym prognozowaniem

Konwencjonalne dane pogodowe często nie uwzględniają gwałtownych powodzi, ponieważ rozwijają się one zbyt szybko i na zbyt małym obszarze. Chociaż temperatury i przepływy rzek są monitorowane w sposób ciągły, zdarzenia te są często zbyt ulotne, aby można je było dokładnie zmierzyć. Ta luka w danych zmniejsza skuteczność modeli głębokiego uczenia się, które doskonale sprawdzają się w prognozowaniu pogody, ale wymagają kompleksowych danych historycznych.

Groundsource: przekształcanie wiadomości w przydatne dane

Aby rozwiązać ten problem, badacze Google wykorzystali swój duży model językowy Gemini do analizy około 5 milionów artykułów prasowych. W ramach tego procesu wyodrębniono informacje o 2,6 milionach powodzi, w wyniku czego utworzono szereg czasowy z odniesieniami geograficznymi o nazwie „Groundsource”. Po raz pierwszy Google wykorzystał modele językowe do stworzenia danych krytycznych do prognozowania pogody. Analizując raporty z całego świata, Groundsource skutecznie wypełnia luki w tradycyjnych danych, szczególnie w regionach pozbawionych rozbudowanej infrastruktury prognozowania pogody.

Jak działa model

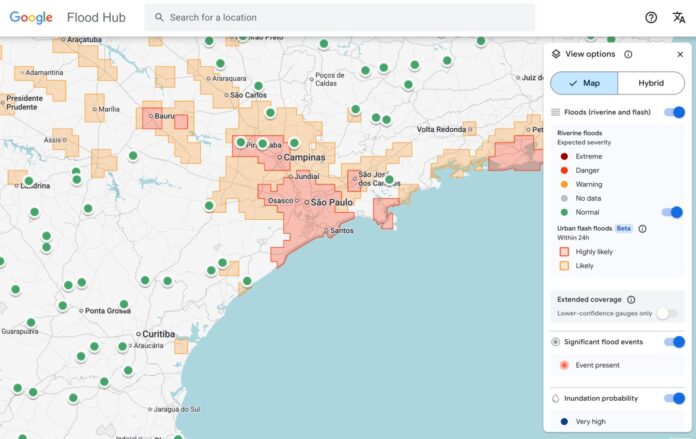

Zbiór danych Groundsource wykorzystano następnie do szkolenia sieci neuronowej o długiej pamięci krótkotrwałej (LSTM). Model ten uwzględnia globalne prognozy pogody i generuje prawdopodobieństwo wystąpienia gwałtownych powodzi na określonych obszarach. W rezultacie powstało narzędzie prognostyczne wdrożone na platformie Google Flood Hub, które zapewnia ocenę ryzyka dla obszarów miejskich w 150 krajach. Dane są również udostępniane agencjom reagowania kryzysowego na całym świecie, co zwiększa ich zdolność do szybkiego reagowania na zbliżające się katastrofy.

Ograniczenia i szersze implikacje

Choć jest to przełom, model ten nie jest pozbawiony ograniczeń. Jego obecna rozdzielczość obejmuje obszary o powierzchni 20 kilometrów kwadratowych, co jest mniej precyzyjne niż systemy takie jak amerykańska National Weather Service, które uwzględniają lokalne dane radarowe. Jednak prawdziwa siła tego projektu leży w jego możliwości zastosowania w regionach, w których rządom brakuje środków na kosztowną infrastrukturę monitorowania pogody.

“Ponieważ agregujemy miliony raportów, zbiór danych Groundsource faktycznie pomaga zrównoważyć mapę. Pozwala nam ekstrapolować dane na inne regiony, w których nie ma wystarczającej ilości informacji. ”

— Juliet Rothenberg, menedżerka programu w zespole Google Resilience

Google planuje rozszerzyć to podejście na inne trudne do przewidzenia zdarzenia, takie jak fale upałów i osunięcia ziemi. Sukces Groundsource pokazuje potencjał dużych modeli językowych w zakresie przekształcania danych jakościowych – doniesień prasowych, relacji naocznych świadków – w spostrzeżenia ilościowe, które prowadzą do rzeczywistych działań. Projekt ten podkreśla rosnącą tendencję wykorzystywania sztucznej inteligencji do wypełniania krytycznych luk w geofizyce, gdzie niedobory w dalszym ciągu stanowią główną przeszkodę w dokładnym modelowaniu.

Ta inicjatywa podkreśla kluczową kwestię: W dobie nadmiaru informacji prawdziwa wartość nie leży w gromadzeniu więcej danych, ale w wydobywaniu znaczenia z tego, co już istnieje.