Firma Google udostępniła Gemini Embedding 2, nowy model sztucznej inteligencji zaprojektowany w celu ujednolicenia sposobu, w jaki maszyny rozumieją i wydobywają informacje z różnych typów mediów. To nie tylko stopniowe doskonalenie; Stanowi to zasadniczą zmianę w sposobie przetwarzania danych przez sztuczną inteligencję, która może obniżyć koszty i zwiększyć szybkość działania przedsiębiorstw polegających na spostrzeżeniach opartych na sztucznej inteligencji.

Problem z poprzednimi osadzanymi modelami

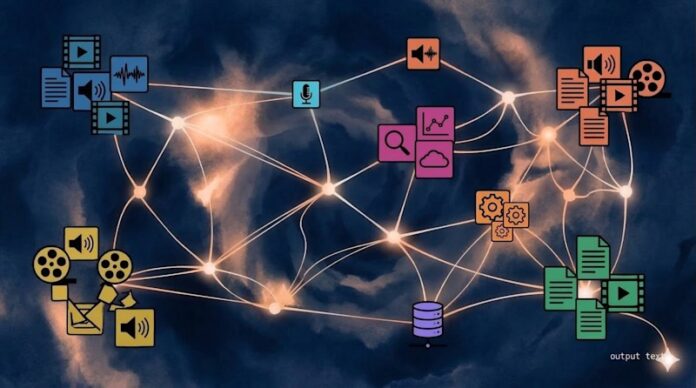

Tradycyjne modele osadzania, które wspomagają wyszukiwanie, rekomendacje i sztuczną inteligencję przedsiębiorstwa, od dawna skupiały się na tekście. Aby przeanalizować obrazy, wideo lub dźwięk, modele te najpierw przetłumaczyły je na tekst, dodając kroki, które powodowały błędy i spowalniały działanie. Gemini Embedding 2 eliminuje to wąskie gardło poprzez natywną integrację tekstu, obrazów, wideo, audio i dokumentów w jedną przestrzeń matematyczną.

Jak działa Gemini Embedding 2: analogia do „Biblioteki Uniwersalnej”

Wyobraź sobie starą bibliotekę zorganizowaną według kategorii, w przeciwieństwie do futurystycznej biblioteki, w której książki są układane samodzielnie w oparciu o ich istotę. Oto, co robi model osadzania: przekształca złożone dane we współrzędne numeryczne na wielowymiarowej mapie. Podobne elementy są grupowane razem, niezależnie od formatu. Zdjęcie golden retrievera i fraza „najlepszy przyjaciel człowieka” staną obok siebie, a wiersz o zachodzie słońca dryfuje w stronę zdjęcia wybrzeża Pacyfiku.

Gemini Embedding 2 mapuje wszystkie multimedia w jedną 3072-wymiarową przestrzeń, umożliwiając programistom przeszukiwanie różnych formatów bez oddzielnych systemów dla obrazów, tekstu lub wideo. Osiąga się to dzięki opracowanej przez Google technologii „Matryoshka Representation Learning”, w ramach której najważniejsze informacje są traktowane priorytetowo pod kątem wydajności.

Dlaczego to ma znaczenie: wydajność i dokładność

Przejście na natywną architekturę multimodalną zapewnia wymierne korzyści:

- Redukcja opóźnień : Niektórzy pierwsi testerzy zgłaszają prędkość przetwarzania do 70%.

- Obniżone koszty : Eliminując pośrednie etapy „tłumaczenia”, firmy mogą zaoszczędzić na zasobach obliczeniowych.

- Głębsze zrozumienie : Model bezpośrednio rozumie dźwięk jako dźwięk, a wideo jako ruch, wychwytując niuanse utracone podczas analizy samego tekstu.

Firmy takie jak Sparkonomy odnotowały już znaczny wzrost wydajności, a Everlaw wykorzystuje ten model do rozwiązywania złożonych zadań związanych z wykrywaniem kwestii prawnych.

Dane techniczne: co programiści muszą wiedzieć

Model przetwarza pliki zawierające do 8192 tokenów tekstowych, sześć obrazów, 128 sekund wideo, 80 sekund audio i sześć stron PDF na każde żądanie. Są to limity wejściowe, a nie magazynowe – system może przetworzyć miliony dokumentów.

Google oferuje wielopoziomowe ceny za pośrednictwem Gemini API i Vertex AI:

- Plan bezpłatny : ograniczony dostęp do eksperymentów.

- Plan płatny : 0,25 USD za milion tokenów na tekst, obrazy i filmy; 0,50 USD za milion tokenów audio.

Model jest również zintegrowany z popularnymi frameworkami AI, takimi jak LangChain i LlamaIndex, co ułatwia wdrożenie. Kod jest objęty licencją Apache 2.0, co pozwala na bezpłatne wykorzystanie komercyjne.

Czy firmy powinny się zmienić?

W przypadku organizacji korzystających z fragmentarycznych potoków AI migracja do Gemini Embedding 2 jest prawdopodobnie strategiczną koniecznością. Model optymalizuje procesy pracy, redukuje błędy i redukuje koszty. Przejście ułatwia ciągłość API i integracja z istniejącymi narzędziami.

Jednak firmy muszą zarządzać limitami wejściowymi, dzieląc duże pliki (dzieląc je na segmenty) przed przetworzeniem. Prawdziwą inwestycją jest ponowne indeksowanie istniejących danych w celu pełnego wykorzystania nowych możliwości.

Podsumowując: Gemini Embedding 2 to nie tylko kolejna aktualizacja AI; to krok w kierunku bardziej ujednoliconego, wydajnego i dokładnego sposobu przetwarzania informacji we współczesnym przedsiębiorstwie.