Google a publié Gemini Embedding 2, un nouveau modèle d’IA conçu pour unifier la façon dont les machines comprennent et récupèrent les informations de différents types de médias. Il ne s’agit pas simplement d’une mise à niveau incrémentielle ; il s’agit d’un changement fondamental dans la manière dont l’IA traite les données, ce qui pourrait potentiellement réduire les coûts et accélérer la vitesse des entreprises qui s’appuient sur des informations basées sur l’IA.

Le problème avec les modèles d’intégration précédents

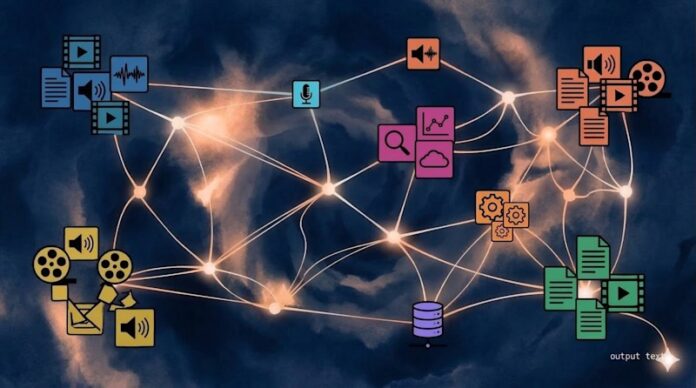

Les modèles d’intégration traditionnels, les moteurs de recherche, de recommandations et d’IA d’entreprise, se sont historiquement concentrés sur le texte. Pour analyser des images, des vidéos ou de l’audio, ces modèles les traduiraient d’abord en texte, en ajoutant des étapes qui introduisaient des erreurs et ralentissaient les performances. Gemini Embedding 2 élimine ce goulot d’étranglement en intégrant de manière native le texte, les images, la vidéo, l’audio et les documents dans un seul espace mathématique.

Comment fonctionne Gemini Embedding 2 : l’analogie de la “bibliothèque universelle”

Pensez à une bibliothèque à l’ancienne organisée par catégories par rapport à une bibliothèque futuriste où les livres s’organisent en fonction de leur essence. C’est ce que fait un modèle d’intégration : il convertit des données complexes en coordonnées numériques dans une carte de grande dimension. Les éléments similaires se regroupent, quel que soit leur format. Une photo d’un golden retriever et l’expression « le meilleur ami de l’homme » seraient placées côte à côte, tandis qu’un poème au coucher du soleil dériverait vers une photographie de la côte du Pacifique.

Gemini Embedding 2 mappe tous les médias dans un espace unifié de 3 072 dimensions, permettant aux développeurs de rechercher dans tous les formats sans systèmes distincts pour l’image, le texte ou la vidéo. Ceci est réalisé grâce au « Matryoshka Representation Learning » de Google, qui donne la priorité aux informations clés pour plus d’efficacité.

Pourquoi c’est important : efficacité et précision

Le passage à une architecture nativement multimodale offre des avantages tangibles :

- Latence réduite : certains premiers testeurs signalent des temps de traitement jusqu’à 70 % plus rapides.

- Coûts réduits : en éliminant les étapes intermédiaires de « traduction », les entreprises peuvent économiser sur les ressources informatiques.

- Compréhension plus approfondie : le modèle comprend directement l’audio comme le son et la vidéo comme le mouvement, capturant les nuances perdues dans l’analyse du texte uniquement.

Des entreprises comme Sparkonomy ont déjà constaté des gains d’efficacité significatifs, tandis qu’Everlaw utilise ce modèle pour gérer des tâches complexes de découverte juridique.

Spécifications techniques : ce que les développeurs doivent savoir

Le modèle gère des fichiers contenant jusqu’à 8 192 jetons de texte, six images, 128 secondes de vidéo, 80 secondes d’audio et six pages PDF par requête. Il s’agit de limites de saisie et non de limites de stockage : le système peut gérer des millions de documents.

Google propose des tarifs différenciés via l’API Gemini et Vertex AI :

- Niveau gratuit : accès limité pour l’expérimentation.

- Niveau payant : 0,25 $ par million de jetons pour le texte, les images et la vidéo ; 0,50 $ par million de jetons pour l’audio.

Le modèle est également intégré aux frameworks d’IA populaires tels que LangChain et LlamaIndex, simplifiant ainsi l’adoption. Le code est sous licence Apache 2.0, permettant une utilisation commerciale sans obligation de redevance.

Les entreprises doivent-elles migrer ?

Pour les organisations qui s’appuient sur des pipelines d’IA fragmentés, la migration vers Gemini Embedding 2 est probablement une nécessité stratégique. Le modèle rationalise les flux de travail, réduit les erreurs et réduit les coûts. La transition est facilitée par la continuité des API et l’intégration avec les outils existants.

Cependant, les entreprises doivent gérer les limites d’entrée en fragmentant les fichiers volumineux (en les divisant en segments) avant le traitement. Le véritable investissement réside dans la réindexation des données existantes pour exploiter pleinement les nouvelles fonctionnalités.

En fin de compte : Gemini Embedding 2 n’est pas simplement une autre mise à niveau de l’IA ; c’est une étape vers une manière plus unifiée, efficace et précise de traiter les informations dans l’entreprise moderne.