Google hat Gemini Embedding 2 veröffentlicht, ein neues KI-Modell, das die Art und Weise vereinheitlichen soll, wie Maschinen Informationen aus verschiedenen Medientypen verstehen und abrufen. Dies ist nicht nur ein inkrementelles Upgrade; Es handelt sich um einen grundlegenden Wandel in der Art und Weise, wie KI Daten verarbeitet, was möglicherweise Kosten senkt und die Geschwindigkeit für Unternehmen erhöht, die auf KI-gestützte Erkenntnisse angewiesen sind.

Das Problem mit früheren Einbettungsmodellen

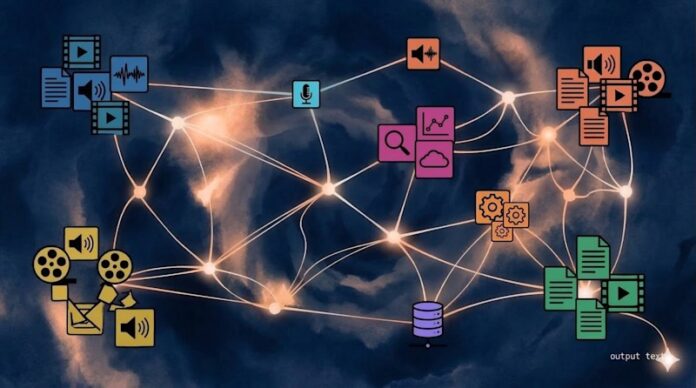

Traditionelle Einbettungsmodelle, die Motoren hinter Suche, Empfehlungen und Unternehmens-KI, haben sich in der Vergangenheit auf Text konzentriert. Um Bilder, Videos oder Audio zu analysieren, übersetzten diese Modelle sie zunächst in Text und fügten Schritte hinzu, die zu Fehlern führten und die Leistung verlangsamten. Gemini Embedding 2 beseitigt diesen Engpass durch die native Integration von Text, Bildern, Video, Audio und Dokumenten in einen einzigen mathematischen Raum.

So funktioniert Gemini Embedding 2: Die „Universal Library“-Analogie

Stellen Sie sich eine altmodische Bibliothek vor, die nach Kategorien geordnet ist, im Gegensatz zu einer futuristischen Bibliothek, in der sich Bücher nach ihrem Wesen ordnen. Genau das macht ein Einbettungsmodell: Es wandelt komplexe Daten in numerische Koordinaten in einer hochdimensionalen Karte um. Ähnliche Elemente gruppieren sich unabhängig vom Format. Ein Foto eines Golden Retrievers und der Satz „Bester Freund des Menschen“ würden nebeneinander stehen, während ein Sonnenuntergangsgedicht auf ein Foto von der Pazifikküste zusteuerte.

Gemini Embedding 2 bildet alle Medien in einem einheitlichen 3.072-dimensionalen Raum ab und ermöglicht Entwicklern die Suche in verschiedenen Formaten ohne separate Systeme für Bild, Text oder Video. Dies wird durch Googles „Matryoshka Representation Learning“ erreicht, das wichtige Informationen zur Effizienzsteigerung priorisiert.

Warum das wichtig ist: Effizienz und Genauigkeit

Der Wechsel zu einer nativen multimodalen Architektur bringt greifbare Vorteile:

- Reduzierte Latenz : Einige frühe Tester berichten von bis zu 70 % schnelleren Verarbeitungszeiten.

- Geringere Kosten : Durch den Wegfall von Zwischenschritten zur „Übersetzung“ können Unternehmen Rechenressourcen einsparen.

- Tieferes Verständnis : Das Modell versteht Audio direkt als Ton und Video direkt als Bewegung und erfasst Nuancen, die bei der reinen Textanalyse verloren gehen.

Unternehmen wie Sparkonomy konnten bereits deutliche Effizienzsteigerungen verzeichnen, während Everlaw das Modell zur Bewältigung komplexer Rechtsermittlungsaufgaben nutzt.

Technische Spezifikationen: Was Entwickler wissen müssen

Das Modell verarbeitet Dateien mit bis zu 8.192 Text-Tokens, sechs Bildern, 128 Sekunden Video, 80 Sekunden Audio und sechs PDF-Seiten pro Anfrage. Hierbei handelt es sich um Eingabegrenzen, nicht um Speicherobergrenzen – das System kann Millionen von Dokumenten verarbeiten.

Google bietet über die Gemini API und Vertex AI gestaffelte Preise an:

- Kostenloses Kontingent : Begrenzter Zugang zum Experimentieren.

- Bezahlte Stufe : 0,25 $ pro Million Token für Text, Bilder und Video; 0,50 $ pro Million Token für Audio.

Das Modell ist auch in beliebte KI-Frameworks wie LangChain und LlamaIndex integriert, was die Einführung vereinfacht. Der Code ist unter Apache 2.0 lizenziert und ermöglicht eine kommerzielle Nutzung ohne Lizenzgebührenpflichten.

Sollten Unternehmen migrieren?

Für Unternehmen, die auf fragmentierte KI-Pipelines angewiesen sind, ist die Migration auf Gemini Embedding 2 wahrscheinlich eine strategische Notwendigkeit. Das Modell rationalisiert Arbeitsabläufe, reduziert Fehler und senkt die Kosten. Der Übergang wird durch die API-Kontinuität und die Integration mit vorhandenen Tools erleichtert.

Allerdings müssen Unternehmen die Eingabegrenzen verwalten, indem sie große Dateien vor der Verarbeitung in Blöcke aufteilen (in Segmente aufteilen). Die eigentliche Investition liegt in der Neuindizierung vorhandener Daten, um die neuen Funktionen voll auszuschöpfen.

Das Fazit: Gemini Embedding 2 ist nicht nur ein weiteres KI-Upgrade; Dies ist ein Schritt hin zu einer einheitlicheren, effizienteren und genaueren Art der Informationsverarbeitung im modernen Unternehmen.